कई बार हम हाल के दिनों में सुन रहे हैं, खासकर के उपयोग के कारण एआरएम द्वारा वास्तुकला Apple और इंटेल Foveros, के बारे में big.LITTLE वास्तुकला प्रोसेसर में, जहां "छोटे" कम खपत वाले सह-अस्तित्व के सबसे हल्के कार्यों के प्रभारी होते हैं और "बिग" कोर को पूरी शक्ति दिलाने के लिए। फिलहाल हमने केवल सीपीयू में इस वास्तुकला को देखा है, लेकिन क्या इसे भी लागू करना संभव होगा ग्राफिक्स कार्ड के लिए जी.पी.यू. ?

इस वास्तुकला की अवधारणा बहुत ही सरल है और एक ही समय में प्रभावी है: हमारे पास दो प्रकार के कोर के साथ एक मरना है, कुछ छोटे जो हमेशा सक्रिय होते हैं और जो प्रकाश कार्यों का ध्यान रखते हैं जैसे कि इंटरनेट ब्राउज़ करना या वर्ड में लिखना, और अन्य बड़े और अधिक शक्तिशाली कोर, जो सामान्य रूप से बंद हैं और एक कार्य की प्रतीक्षा कर रहे हैं जिसकी आवश्यकता है ज़्यादा शक्ति जागने के लिए और पदभार संभालने के लिए। प्रोसेसर में इस बड़े.लिफ्ट आर्किटेक्चर का उपयोग किया जाता है, जहां कोर की गिनती काफी कम है, खासकर जब एक की तुलना में GPU, जहां कोर की संख्या हजारों में है .

NVIDIA ऑप्टिमस पहले से ही GPU पर एक प्रकार का बड़ा था

आप में से कई ऐसे दिन याद करेंगे जब एक समर्पित जीपीयू वाले लगभग सभी लैपटॉप थे NVIDIA ऑप्टिमस तकनीक। इस तकनीक का मतलब था कि जब हम डेस्क पर थे या ऐसे कार्य कर रहे थे जो 3D नहीं थे, तो प्रोसेसर में एकीकृत ग्राफिक्स कार्ड का उपयोग ऊर्जा बचाने के लिए किया जाता था, लेकिन जब हमने किसी गेम या 3D कार्य को अंजाम दिया तो समर्पित ग्राफिक्स का उपयोग किया जा सकता था। सारी शक्ति उपलब्ध है।

इस तथ्य का लाभ उठाने का यह चतुर तरीका है कि नोटबुक में दो GPU थे, संक्षेप में, एक प्रकार का बड़ा .ITTLE लेकिन क्रूड मोड में (संपूर्ण वास्तुकला होने के बजाय), लेकिन विचार मूल रूप से एक ही है: जब GPU जरूरत नहीं है "बड़ा" बंद है और स्टैंडबाय पर, iGPU के साथ सभी काम करते हुए यह बिजली की बचत और उत्पन्न गर्मी को कम कर सकता है। जब जरूरत होती है, तो "बड़ा" जीपीयू चरम प्रदर्शन में किक करता है और बचाता है।

तो क्या यह कुछ ऐसा है जिसे लागू किया जा सकता है?

बेशक, विचार बहुत अच्छा है, लेकिन या तो वे एक ही पीसीबी पर दो जीपीयू को उसी कार्यक्षमता के लिए एकीकृत करते हैं, जिसके बारे में हमने पहले बात की है या चीजें काफी जटिल हैं, और यह 4-16 करोड़ के साथ काम करने के लिए समान नहीं है। सी पी यू कई हजार जीपीयू के साथ हो सकता है (इसे संदर्भ में कहें तो, एक Radeon RX 6800 XT में 3,840 Shader Processors (cores) हैं, जबकि RTX 3090 की कीमत 10,496 CUDA कोर है)।

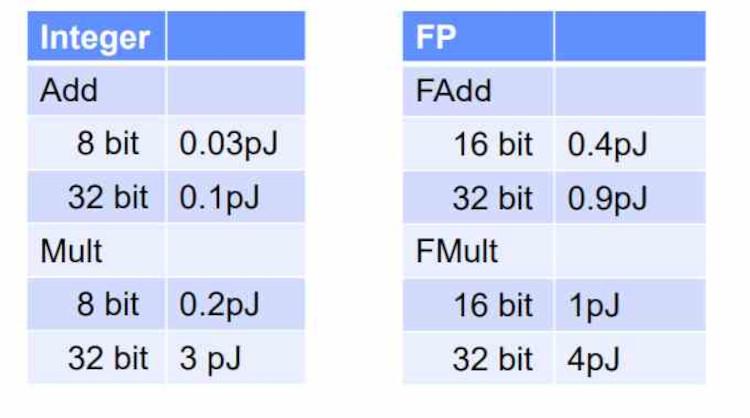

इस वास्तुकला के पूर्ण कार्यान्वयन के लिए, GPU के काम करने के तरीके को फिर से परिभाषित करना आवश्यक होगा, क्योंकि वर्तमान में उनके पास पहले से दो प्रकार के ALU हैं: एक का उपयोग सरल निर्देशों के लिए किया जाता है और जिनकी खपत बहुत कम है, जबकि अन्य (SFU) जिम्मेदार हैं अधिक जटिल संचालन जैसे कि वर्गमूल, लघुगणक, शक्तियाँ और त्रिकोणमितीय परिचालनों के लिए। वे बड़े नहीं हैं। टाइटेल गुठली, लेकिन वास्तव में उन्हें पहले से ही अलग तरीके से कहा जाता है (FP32 ALUs) ठीक इसी कारण से।

तो आप देखते हैं, वास्तव में दोनों ऑप्टिमस के साथ अतीत में और आज बड़े के समान कुछ। लिट्ल पहले से ही GPU में लागू है, क्या होता है कि यह स्पष्ट रूप से अलग है, यह अलग तरह से काम करता है और इसे ऐसा नहीं कहा जाता है। हालाँकि, चूंकि हाल के दिनों में सब कुछ खपत के मामले में अधिक दक्षता पर केंद्रित होना प्रतीत होता है, यह ऐसी चीज है जिसे हम बाहर नहीं कर सकते हैं, और निश्चित रूप से NVIDIA और एएमडी इसे बाहर ले जाने की क्षमता है। बेशक, यह ऊर्जा को बचाने और कम गर्मी पैदा करने के लिए एक आदर्श स्थिति होगी, है ना?