Användningen av artificiell intelligens används i en mängd olika användningsområden, fortfarande med dess gränser och begränsningar som måste definieras. En av de farhågor som kan uppstå, särskilt i fallet med samtals-AI av ChatGPT-typ, är hur mycket de ska räkna och hur mycket de ska vara tysta … och den röda linjen verkar vara tydligare än vi tror.

Det finns ett talesätt som säger "Jag är mer värd för det jag håller tyst än för det jag talar" och det är just det nya mervärdet som man vill ge en AI: att undvika att avslöja hemligheter.

Hur man förhindrar en AI från att dela hemligheter

Ta Github till exempel, som har uppdaterat AI-modellen av Copilot , en programmeringsassistent som genererar källkod och funktionsrekommendationer i realtid i Visual Studio, och hävdar att den nu är säkrare och kraftfullare.

För att göra detta levererar den nya AI-modellen, som kommer att släppas till användare den här veckan, bättre kvalitetsförslag på kortare tid, vilket ytterligare förbättrar mjukvaruutvecklarnas effektivitet genom att öka acceptansgraden. Copilot kommer med den här uppdateringen att introducera ett nytt paradigm som kallas "Fill-In-the-Middle", som använder ett bibliotek med kända kodkommandon och lämnar ett tomrum för AI-verktyget att fylla , vilket gör det mer relevant och förenligt med resten. av projektkoden.

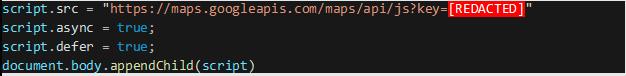

En av de mest anmärkningsvärda förbättringarna i den här Copilot-uppdateringen är introduktionen av ett nytt sårbarhetsfiltreringssystem som hjälper till att identifiera och blockera osäkra tips som t.ex. förvrängda referenser, sökvägsinjektioner och SQL-injektioner . Mjukvaruföretaget säger att Copilot kan generera hemligheter som nycklar, referenser och lösenord som tittar i träningsdata på nya strängar. Dessa kan dock inte användas eftersom de är helt fiktiva och kommer att blockeras av det nya filtreringssystemet.

Stark kritik för att avslöja hemligheter

Uppkomsten av dessa hemligheter i Copilots kodtips har dragit stark kritik från mjukvaruutvecklingssamhället, med många anklagar Microsoft att använda stora allmänt tillgängliga datamängder för att träna sina AI-modeller utan hänsyn till säkerheten, även inklusive set som innehåller hemligheter av misstag .

Genom att blockera osäkra förslag i realtidsredigeraren kan GitHub också ge ett visst motstånd mot datasetförgiftningsattacker som syftar till att i hemlighet träna AI-assistenter att komma med förslag som innehåller skadliga nyttolaster.

Vid denna tidpunkt utbildas fortfarande Copilots LLM (Long Learning Models) till skilja mellan sårbara och icke-sårbara kodmönster , så AI-modellens prestanda på den fronten förväntas gradvis förbättras inom en snar framtid. .