Dacă ați citit specificațiile complete ale unora dintre cele mai recente Intel CPU-uri, veți face am văzut apariția unor acronime misterioase: GNA. În realitate, este un procesor mic sau mai degrabă un coprocesor care este responsabil pentru accelerarea anumitor Invatare profunda algoritmi și, prin urmare, sunt strâns legate de implementarea inteligenței artificiale. Vă explicăm în ce constă acest coprocesor și care este funcționalitatea sa.

Procesoarele dedicate accelerării anumitor sarcini de zi cu zi, folosind modele dezvoltate prin inteligență artificială, au apărut în ultimii ani în toate configurațiile și dimensiunile și nu este surprinzător faptul că Intel nu a vrut să rămână în urmă.

Ce este Intel GNA?

Intel GNA este coprocesorul pe care unele procesoare Intel l-au integrat și care servește la accelerarea execuției unor algoritmi de inferență. Acestea fiind spuse, mulți dintre voi vor ști deja că, prin urmare, ne confruntăm cu un procesor de tip neuronal, care în acest caz a fost introdus pentru prima dată în Intel Ice Lake, iar acronimul său înseamnă Accelerator Neural Gaussian ( GNA ), iar integrarea în propriul procesor funcționează la un consum foarte mic.

Este destinat să fie utilizat pentru sarcini precum transcrierea audio în timp real sau eliminarea zgomotului fotografic, care sunt tipice pentru AI, dar nu necesită un accelerator de mare putere.

Acesta a fost recent îmbunătățit la Lacul Tiger, unde a fost implementată versiunea 2.0 a GNA, care este destinată să fie utilizată și pentru anularea zgomotului ambiental și reducerea zgomotului din fotografii. Cu aceasta putem deduce că GNA este conceput pentru medii de afaceri colaborative, în special cele bazate pe telelucrare, în care transcrierea textului și că comunicarea se realizează fără zgomot de orice fel este foarte importantă.

Cum functioneaza?

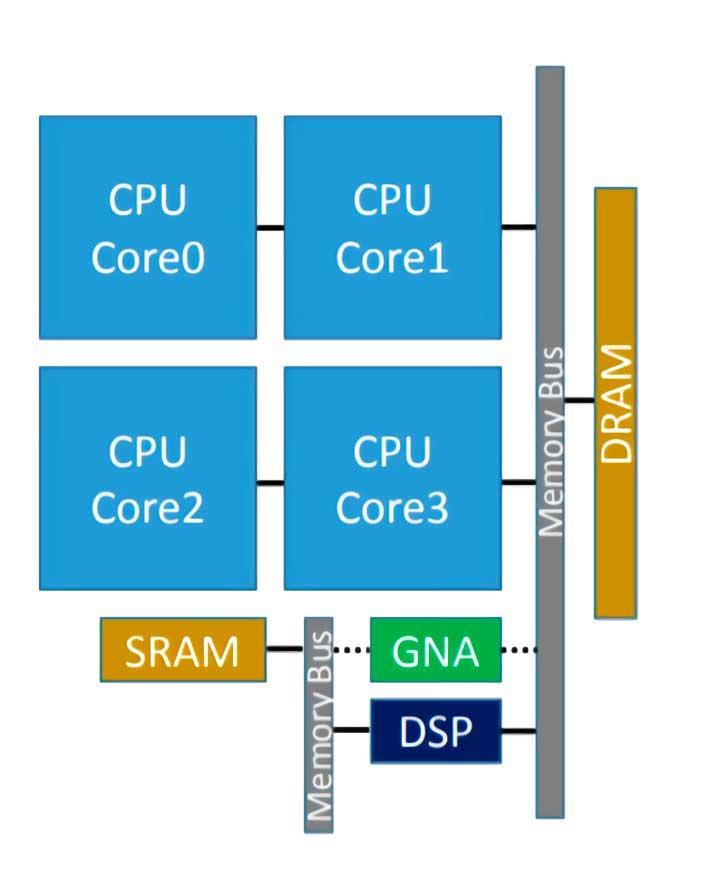

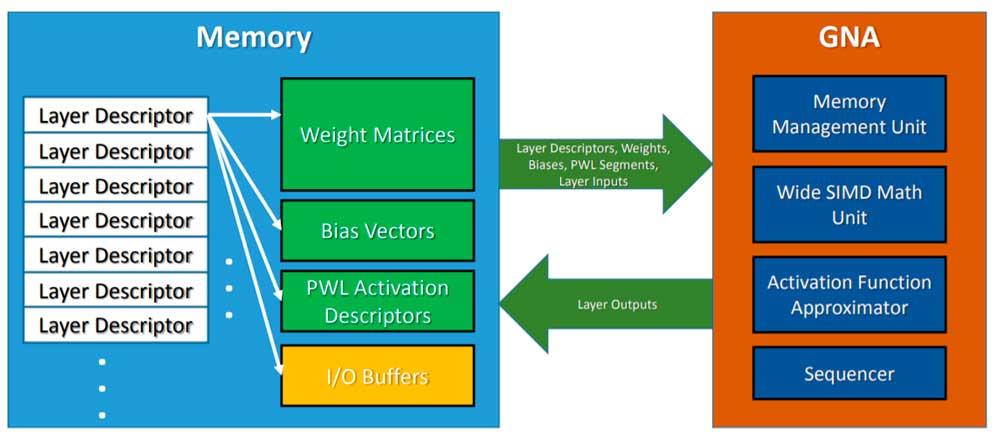

GNA Intel nu este o unitate de execuție a Procesor deci avem de-a face cu un procesor în cadrul altuia și servește la accelerarea anumitor sarcini pentru oaspeții săi. Aceasta înseamnă că trebuie să fie invocat în mod explicit în cod printr-un API, în acest caz API dedicat Intel.

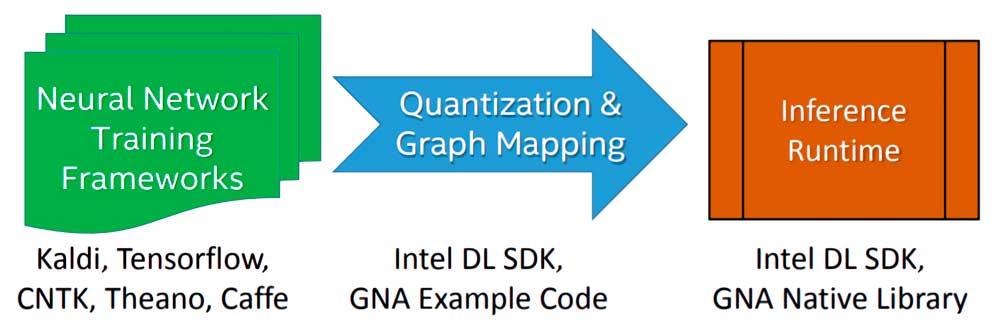

Implementarea unui algoritm sau model Deep Learning care urmează să fie executat de Intel GNA în etapa de inferență se face în trei etape:

- Începem prin antrenarea algoritmului folosind o rețea neuronală în virgulă mobilă cu un cadru de alegere liberă.

- Modelul rezultat din instruire este importat folosind Instrumentul de implementare Intel Deep Learning SDK care permite importul oricărui model generat de cele mai faimoase și utilizate framework-uri Deep Learning.

- Se conectează cu Intel Deep Learning SDK Inference Engine sau cu bibliotecile native GNA, dintre care există două: una pentru Intel Quark și cealaltă pentru Intel Atom și Intel Core.

Pentru a invoca GNA, ceea ce face CPU este să lase modelul de inferență în memorie, iar GNA este invocat să adopte algoritmul menționat și să îl execute în paralel cu activitatea procesorului căruia este gazda. De asemenea, trebuie luat în considerare faptul că este o unitate cu putere redusă, deci nu ne putem aștepta la aceleași rezultate ca și utilizarea unei rețele neuronale performante sau a unui FPGA configurat ca atare, dar este suficient de bun pentru sarcini simple de la o zi la alta. .

GNA Intel în afara CPU-urilor Intel

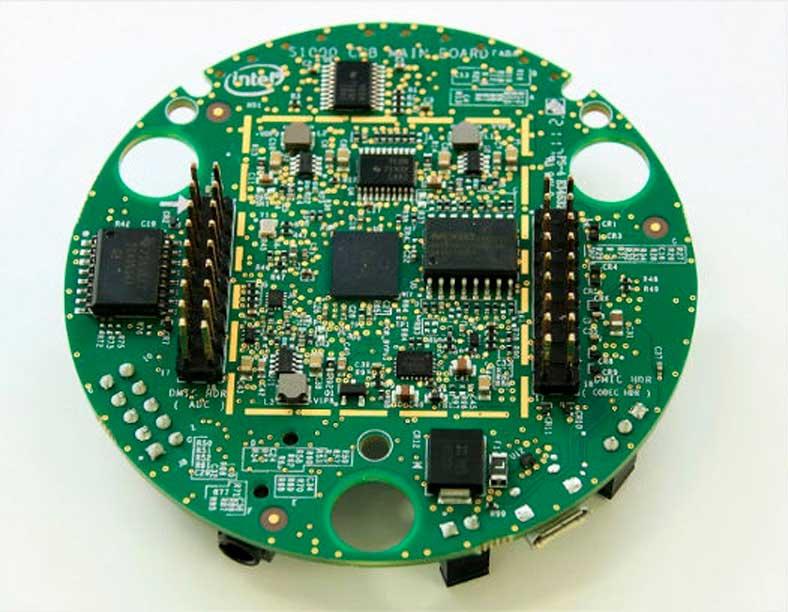

Deși GNA este el însuși un procesor care este integrat ca parte a procesoarelor x86, poate fi implementat în afara procesorului, dacă se dorește, cel mai faimos caz fiind Kitul Intel Dev pentru activarea vorbirii , care este utilizat în special pentru deducerea comenzilor vocale pentru aplicații pentru Amazon Alexa dispozitive.