Derzeit konzentrieren sich die meisten Angriffe gegen Systeme der künstlichen Intelligenz (KI) auf deren Manipulation. So versuchen beispielsweise Empfehlungssysteme, bestimmte Inhalte zu bevorzugen, anstatt das, was ihnen rechtmäßig entsprechen würde. Cyberkriminelle nutzen diese Art von Angriffen jetzt mithilfe von maschinellem Lernen (ML) und wurden in einer Bedrohungsmatrix beschrieben.

Laut Microsoft, Angriffe auf maschinelle Lernsysteme (ML) sind nach und nach zunehmen . Darüber hinaus gibt MITRE an, dass in den letzten drei Jahren große Unternehmen wie Microsoft, Google, Amazon und Tesla ihre ML-Systeme kompromittiert haben. In diesem Sinne verfügen die meisten Unternehmen nicht über die richtigen Lösungen zum Schutz ihrer maschinellen Lernsysteme und suchen nach Anleitungen dazu.

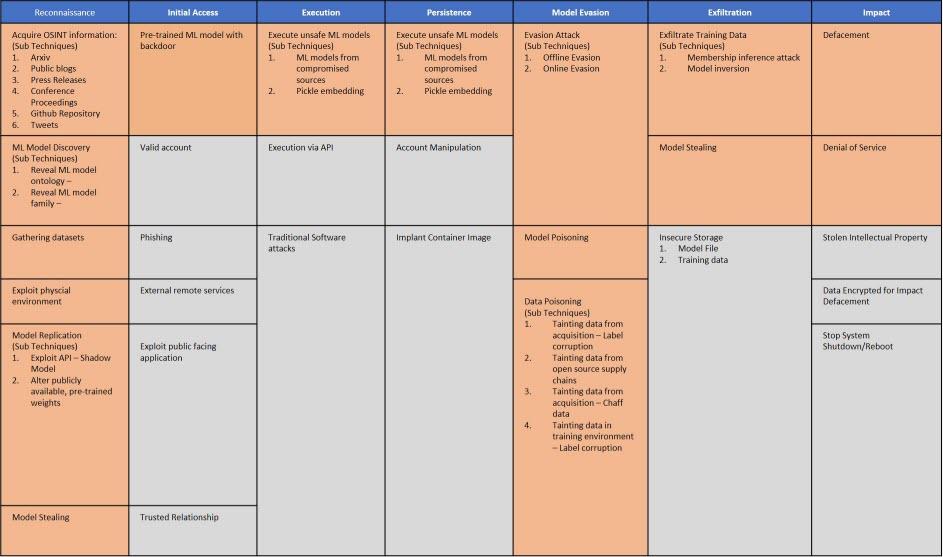

So haben Experten von Microsoft, MITRE, IBM, NVIDIADie University of Toronto, das Berryville Institute of Machine Learning und andere Unternehmen und Organisationen haben die erste Version von erstellt Widersprüchliche ML-Bedrohungsmatrix . Ziel ist es, eine Bedrohungsmatrix zu erstellen, mit der Sicherheitsanalysten diese Art von Angriffen erkennen und darauf reagieren können.

Künstliche Intelligenz als Methode zur Durchführung von Angriffen

Künstliche Intelligenz ist eine Ressource, die zunehmend dazu verwendet wird, Computer zu infizieren, Informationen zu stehlen und die Sicherheit zu gefährden. Eine der Techniken, mit denen wir künstliche Intelligenz und maschinelles Lernen einsetzen können, ist die Datenvergiftung.

Dieser Angriff soll einen Trainingsdatensatz manipulieren, um das Vorhersageverhalten zu steuern. Das Ziel ist, dass es nicht funktioniert und den Räumlichkeiten des Angreifers gehorcht. Auf diese Weise können Sie Spam-E-Mails als geeigneten Inhalt klassifizieren und sie erreichen unseren Posteingang. Hier ist ein Beispiel dafür, wie künstliche Intelligenz verwendet wird bei Cyberangriffen .

Maschinelles Lernen und Sicherheit

Maschinelles Lernen, das aus ML (Machine Learning) stammt, ist ein Zweig der künstlichen Intelligenz, dessen Ziel es ist, Techniken zu entwickeln, mit denen Computer autonom lernen können. Forscher des maschinellen Lernens suchen nach Algorithmen, um Datenproben in Computerprogramme umzuwandeln, ohne sie schreiben zu müssen. Daher müssen die resultierenden Programme in der Lage sein, Verhaltensweisen zu verallgemeinern, Vorhersagen zu treffen, Entscheidungen zu treffen oder Dinge präzise zu klassifizieren.

Mikel Rodríguez, ein Forscher für maschinelles Lernen bei MITRE, hat kommentiert, dass wir uns jetzt mit AI in der gleichen Phase befinden wie mit dem Internet Ende der 1980er Jahre. Zu dieser Zeit war das Internet so konzipiert, dass es funktioniert, und es sollte nicht eigenständig aufgebaut werden. Sicherheit, um mögliche Angriffe abzuschwächen.

Sie können jedoch aus diesem Fehler lernen, und deshalb wurde die Adversarial ML Threat Matrix erstellt. Was erreicht werden soll, ist, dass diese Matrix hilft, ganzheitlich zu denken, und eine bessere Kommunikation anregt. Daher soll die Zusammenarbeit zwischen Organisationen gefördert werden, indem eine gemeinsame Sprache für die verschiedenen Schwachstellen bereitgestellt wird.

Was uns die gegnerische ML-Bedrohungsmatrix gibt

Dank dieser Bedrohungsmatrix können Sicherheitsadministratoren mit Modellen arbeiten, die auf realen Vorfällen basieren und das Verhalten eines Gegners mithilfe von maschinellem Lernen nachahmen. Zum Erstellen der Matrix wurde ATT & CK als Vorlage verwendet, da Sicherheitsanalysten mit der Verwendung dieses Matrixtyps vertraut sind.

In der Bedrohungsmatrix haben wir die verschiedenen Phasen des Angriffs, wie z. B. Erkennung, anfänglicher Zugriff, Ausführung, Persistenz, Ausweichen, Exfiltration und Auswirkung. Auf diese Weise finden wir in der zweiten Phase des Erstzugriffs die Phishing Angriff, über den so viel gesprochen wird. Wenn Sie weitere Informationen zur Beschreibung der Phasen der kontradiktorischen ML-Matrix erhalten möchten, finden Sie hier diesen Link.

Eine wichtige Tatsache ist, dass die Bedrohungsmatrix kein Rahmen für die Risikopriorisierung ist und nur bekannte Techniken kompiliert. Darüber hinaus wurde gezeigt, dass Angriffe der Matrix zugeordnet werden können. Zuletzt wird die Bedrohungsmatrix regelmäßig aktualisiert, sobald Feedback von der Community für sicheres maschinelles Lernen und von Gegnern eingeht. Sie möchten die Mitarbeiter auch ermutigen, auf neue Techniken hinzuweisen, Best Practices vorzuschlagen und Beispiele für erfolgreiche Angriffe auszutauschen.