Využití umělé inteligence se používá v mnoha různých použitích, přičemž její limity a omezení budou teprve definovány. Jedna z obav, která se může objevit, zejména v případě konverzační AI typu ChatGPT, je jak moc mají počítat a jak moc mlčet … a ta červená čára se zdá být jasnější, než si myslíme.

Existuje přísloví, které říká: „Jsem cennější za to, co pomlčím, než za to, co mluvím“, a to je přesně ta nová přidaná hodnota, kterou má AI získat: vyhnout se prozrazení tajemství.

Jak zabránit AI ve sdílení tajemství

Vzít Například Github, který aktualizoval model umělé inteligence Copilota , programovací asistent, který generuje zdrojový kód a doporučení funkcí v reálném čase ve Visual Studiu a tvrdí, že je nyní bezpečnější a výkonnější.

Za tímto účelem nový model umělé inteligence, který bude uživatelům vydán tento týden, přináší kvalitnější návrhy za kratší dobu a dále zvyšuje efektivitu vývojářů softwaru zvýšením míry přijetí. Copilot touto aktualizací zavede nové paradigma nazvané „Fill-In-the-Middle“, které využívá knihovnu známých kódových příkazů a ponechává mezeru, kterou může nástroj AI vyplnit , takže je relevantnější a konzistentnější se zbytkem. kódu projektu.

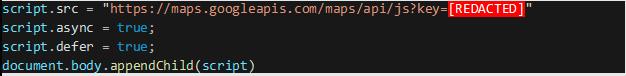

Jedním z nejpozoruhodnějších vylepšení této aktualizace Copilota je zavedení nového systému filtrování zranitelností, který pomůže identifikovat a blokovat nezabezpečené rady, jako je např. zakódované přihlašovací údaje, vkládání cesty a vkládání SQL . Softwarová společnost říká, že Copilot dokáže generovat tajemství, jako jsou klíče, přihlašovací údaje a hesla, která se zaměřují na trénovací data na nových řetězcích. Ty však nelze použít, protože jsou zcela smyšlené a budou blokovány novým systémem filtrování.

Silná kritika za odhalování tajemství

Objevení se těchto tajemství v kódu Kopilota napovídá nakreslil silná kritika ze strany komunity vývojářů softwaru s mnoha obviněními Microsoft používání velkých veřejně dostupných souborů dat k trénování svých modelů umělé inteligence bez ohledu na bezpečnost, včetně sady, které omylem obsahují tajemství .

Blokováním nebezpečných návrhů v editoru v reálném čase by GitHub mohl také poskytnout určitou odolnost proti útokům otravy datových sad, jejichž cílem je skrytě vycvičit asistenty AI, aby předkládali návrhy, které obsahují škodlivé užitečné zatížení.

V současné době se LLM (modely dlouhého učení) Copilot stále školí rozlišovat mezi zranitelnými a nezranitelnými kódovými vzory , takže se očekává, že výkon modelu AI na této frontě se v blízké budoucnosti postupně zlepší. .